3. Sandbox-Projekt mit ANYbotics

Der folgende Abschnitt zeigt am Anwendungsfall des Inspektionsroboters ANYmal, wie autonome Inspektionssysteme in der Praxis eingesetzt werden und wie Hersteller mit EU-Regulierungen und KI-Governance umgehen können.

3.1 Anwendungsfall ANYmal

Im Rahmen der Innovation Sandbox für KI diente das Produkt ANYmal als Anwendungsfall, um regulatorische Anforderungen zu klären. ANYmal ist ein autonomer, vierbeiniger Inspektionsroboter des Schweizer Unternehmens ANYbotics, entwickelt für anspruchsvolle Industrieumgebungen wie Energieanlagen, Offshore-Plattformen oder chemische Betriebe. Dank seiner dynamischen Laufmechanik kann er sich stabil über unebenes Gelände, Treppen und Gitterroste bewegen – überall dort, wo rad- oder kettenbasierte Systeme an ihre Grenzen stossen.

Die Plattform kombiniert drei integrierte KI-Komponenten, die meist lokal auf leistungsfähigen CPU/GPU-Einheiten verarbeitet werden:

- Reinforcement Learning für Lokomotion:

adaptive Fortbewegung in komplexen Umgebungen

- Selbstlernende Navigation:

autonome Wegfindung und Hindernisvermeidung

- Supervised Learning für Inspektionen:

Auswertung visueller, akustischer und physikalischer Sensordaten

ANYmal nutzt ein multimodales Sensorsystem, zu dem unter anderem folgende Komponenten gehören:

- 360°-LIDAR für eine SLAM-basierte Kartierung und Navigation

- Tiefen- und Zoomkameras für die visuelle Erkennung und Dokumentation

- Wärmebildkamera zur Temperaturüberwachung

- Akustik- und Vibrationssensoren zur Zustandsüberwachung von Maschinen

Die Kommunikation läuft typischerweise über WLAN, 5G oder Edge-Computing-Schnittstellen und ist direkt mit digitalen Zwillingen oder industriellen Überwachungssystemen verbunden. Die Energieversorgung erfolgt über eine automatische Ladestation, die einen kontinuierlichen Betrieb gewährleistet.

Kernfunktionen von ANYmal:

- Mobiles Mapping und 3D-Scanning:

Erfassung ganzer Anlagen in hoher Auflösung - Sensorintegration:

Temperatur, Leckage, visuelle Anzeigen (z.B. Füllstände, Manometer), Geräusche und Vibration - Intelligente Inspektion:

automatische Anpassung der Sensorposition (z.B. Kamerawinkel bei Spiegelung), zusätzliche Aufnahmen bei Unklarheiten) - Echtzeitübertragung:

direkte Übermittlung der Informationen ins zentrale Überwachungssystem oder in den digitalen Zwilling der Anlage - Robustes Design:

Schutz gegen Hitze, Staub, Feuchtigkeit, explosive Umgebungen (ATEX-zertifizierte Version verfügbar)

ANYmal wird heute weltweit in produktiven Umgebungen eingesetzt – von Energieversorgern bis hin zur chemischen Industrie. Der Roboter unterstützt bspw. bei Routinekontrollen, bei der präventiven Wartung oder bei Notfalleinsätzen.

Beispielanwendung 1: Chemieanlage

In einer chemischen Produktionsanlage wird der autonome Inspektionsroboter ANYmal im Regelbetrieb für tägliche Kontrollgänge eingesetzt. Er prüft über 120 visuelle, thermische und akustische Inspektionspunkte pro Mission, darunter Temperaturanzeigen, Pumpengeräusche und Korrosionsmerkmale. Abweichungen werden dokumentiert und automatisch gemeldet. Die dabei erfassten Daten fliessen in den digitalen Zwilling der Anlage ein und unterstützen eine kontinuierliche Zustandsüberwachung. Laut Betreiber konnte durch den Einsatz des Systems eine messbare Steigerung der Anlagenverfügbarkeit erreicht werden. Eine Ausweitung auf weitere Standorte ist vorgesehen.

Beispielanwendung 2: Offshore-Anlage

Auf einer Offshore-Anlage wird der autonome Inspektionsroboter ANYmal X im Rahmen regelmässiger Kontrollgänge eingesetzt. Er prüft visuelle, thermische und akustische Merkmale an Ventilen, Pumpen und elektrischen Anlagen – auch in explosionsgefährdeten Bereichen mit hoher Luftfeuchtigkeit und wechselnden Witterungsbedingungen. Die Inspektionen erfolgen auf mehreren Ebenen und in schwer zugänglichen Bereichen. Die dabei erfassten Daten werden automatisch an das Instandhaltungsteam übermittelt und in bestehende digitale Systeme integriert. Laut Betreiber leistet das System einen Beitrag zur Reduktion personeller Präsenz in sicherheitskritischen Zonen und zur kontinuierlichen Überwachung des Anlagenzustands.

Beispielanwendung 3: Rechencenter

In einem Rechencenter wird der autonome Inspektionsroboter ANYmal für regelmässige Kontrollgänge eingesetzt. Er überwacht visuelle, thermische und akustische Zustandsmerkmale an gebäudetechnischen Anlagen wie Kühlung, Stromversorgung und Verkabelung – auch bei schlechten Lichtverhältnissen oder in der Nacht. Die Inspektionsdaten werden automatisch aufgezeichnet und an die betriebseigene Wartungsplattform übermittelt. Abweichungen werden erkannt und gemeldet, um frühzeitig manuelle Eingriffe zu ermöglichen. Laut Betreiber trägt der Einsatz des Systems zur Erhöhung der Betriebssicherheit und zur Automatisierung wiederkehrender Prüfaufgaben bei. Der Roboter ist dauerhaft im Einsatz und führt mehrere Inspektionsmissionen pro Tag durch.

Die drei Anwendungsbeispiele – Chemieanlage, Offshore-Plattform und Rechencenter – verdeutlichen die Bandbreite möglicher Einsatzbereiche autonomer Inspektionsrobotik in realen Industrieumgebungen. Sie zeigen, wie solche Systeme dazu beitragen können, bestehende Kontrollprozesse zu ergänzen, insbesondere in schwer zugänglichen oder sicherheitskritischen Bereichen. Gleichzeitig machen sie deutlich, welche technischen, organisatorischen und regulatorischen Fragen bei der Einführung solcher Technologien zu berücksichtigen sind.

Nutzen in der Praxis:

- Verbesserte Inspektion, um Risiken und technische Probleme frühzeitig zu erkennen

- Reduktion von Personaleinsätzen in gefährlichen Zonen

- Basis für vorausschauende Wartung und langfristige Kostensenkung

- Lückenlose Dokumentation und verbesserte Datenqualität

- Entlastung von Fachpersonal bei repetitiven Kontrollaufgaben

- Integration in digitale Zwillinge und bestehende Monitoringsysteme

Herausforderungen in der Umsetzung

- Integration in bestehende Infrastrukturen und IT-Systeme

- Anpassung der Betriebsabläufe an robotergestützte Inspektionsprozesse

- Schulung von Personal für Betrieb und Wartung des Systems

- Anspruchsvolle Umweltbedingungen (z.B. extreme Hitze, Feuchtigkeit)

- Netzwerkverbindung für die Echtzeitdatenübertragung

- Kontinuierliche Systemkalibrierung und Fehlererkennung

3.2. Umgang mit EU-Regulierungen

Die rechtliche Einordnung autonomer Inspektionsroboter stellt Hersteller und Regulierungsbehörden vor komplexe Herausforderungen. Insbesondere die Schnittstelle zwischen der EU-KI-Verordnung und der EU-Maschinenverordnung wirft zentrale Fragen auf: Unter welchen Voraussetzungen sind solche Systeme als Hochrisiko-KI-Systeme (HRKIS) einzustufen (siehe Kapitel 2.2)? Welche Pflichten ergeben sich daraus für die Hersteller, und welche Möglichkeiten entstehen durch verschiedene Auslegungen? Das folgende Kapitel analysiert am Beispiel des Roboters ANYmal (siehe Kapitel 3.1) mögliche Strategien im Umgang mit den regulatorischen Anforderungen. Dabei werden zwei Szenarien gegenübergestellt. Im ersten Szenario wird der Roboter nicht als HRKIS eingestuft, im zweiten hingegen schon. In diesem Fall werden die entsprechend strengeren Anforderungen proaktiv umgesetzt.

«Für ANYbotics ist die Umsetzung verschiedener EU-Regulierungen zentral für den Marktzugang.»

Dr. Christian Gehring, Co-Founder and Sr. Director of Robotics & AI

Im ersten Szenario wird argumentiert, dass der Inspektionsroboter nicht als HRKIS einzustufen ist. Der Vorteil dieser Herangehensweise liegt darin, dass Systeme, die nicht als hoch riskant gelten, weniger strenge Anforderungen erfüllen müssen. Der Nachteil ist, dass die Argumente gegen eine Einordnung als HRKIS im konkreten Fall teilweise nicht sehr belastbar sind. Sollte es zu einer behördlichen oder gerichtlichen Beurteilung kommen, besteht das Risiko, dass diese zu einer abweichenden Einschätzung gelangt. Dann müsste der Roboter nach dem neu eingeführten Konformitätsbewertungsverfahren der EU-KI-Verordnung zertifiziert werden. Dieses Verfahren ist bei den zuständigen Prüfstellen (den sog. notifizierten Stellen) noch nicht etabliert, was aus Sicht des Sandbox-Teams zu Unklarheiten, grösserem Aufwand und höheren Zertifizierungskosten führen kann. Im zweiten Szenario wird argumentiert, dass es sich beim Roboter um ein HRKIS handelt. Der Hersteller setzt in diesem Fall die entsprechenden Anforderungen der EU-KI-Verordnung um. Der Vorteil dieser Strategie besteht darin, dass der Roboter nicht über das neue Konformitätsbewertungsverfahren der EU-KI-Verordnung, sondern über das bereits etablierte Konformitätsbewertungsverfahren der EU-Maschinenverordnung zertifiziert werden kann. Dieses Verfahren ist bei den notifizierten Stellen bereits etablierter – mit Ausnahme der Anforderungen nach EU-KI-Verordnung –, was zu weniger Unsicherheiten und zu geringeren Kosten führt. Nachteilig ist jedoch, dass HRKIS strengere Anforderungen erfüllen müssen als nicht hoch riskante Systeme.

I. Szenario 1: keine Qualifikation als HRKIS

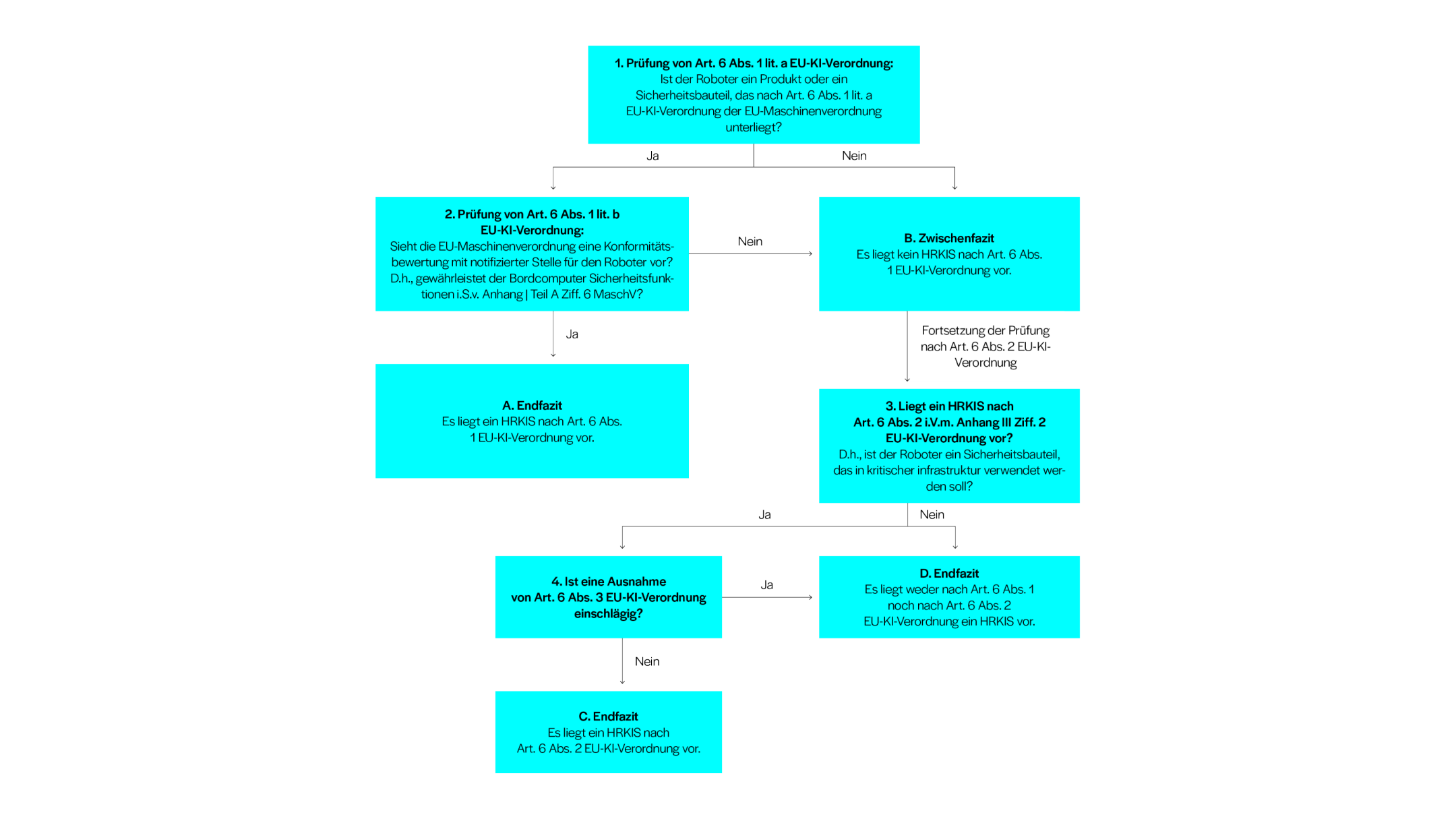

Das Szenario 1 umfasst verschiedene Optionen, mit denen eine Einstufung des Roboters als HRKIS vermieden werden kann. Sie sind in einem Entscheidungsbaum dargestellt, der schrittweise durch die relevanten Prüfungen führt. Ausgangspunkt ist die Analyse der Anforderungen gemäss Artikel 6 Absatz 1 der EU-KI-Verordnung, gefolgt von der Prüfung nach Artikel 6 Absatz 2. Im Anschluss daran werden jene Entscheidungswege erläutert, die aus Sicht des Sandbox-Teams eine vertretbare Grundlage dafür bieten, den Roboter nicht als HRKIS einzuordnen.

Option 1: kein Sicherheitsbauteil

Ein vertretbarer Weg innerhalb des ersten Szenarios ergibt sich aus folgendem Pfad im Entscheidungsbaum:

1. Ja | 2. Nein | 3. Nein → D

Zuerst muss geprüft werden, ob der Roboter ein Produkt oder ein Sicherheitsbauteil nach Artikel 6 Absatz 1 Buchstabe a der EU-KI-Verordnung ist und unter die EU-Maschinenverordnung fällt. Das Sandbox-Team nimmt an, dass dies zutrifft, denn ANYbotics hat den Roboter bislang bereits unter der bisherigen EU-Maschinenrichtlinie bewertet. Diese Annahme wurde allerdings nicht vertieft überprüft. Zu beachten ist, dass die Voraussetzungen der Buchstaben a und b von Artikel 6 Absatz 1 der EU-KI-Verordnung kumulativ erfüllt sein müssen. Wenn also der Roboter kein Sicherheitsbauteil oder Produkt nach Buchstabe a ist, dann muss nicht mehr geprüft werden, ob er nach Buchstabe b einer Konformitätsbewertung unterzogen werden muss. Da es jedoch sehr wahrscheinlich ist, dass Buchstabe a bei ANYmal erfüllt ist, muss geprüft werden, ob auch Buchstabe b erfüllt ist.

Das Sandbox-Team argumentiert, dass der Roboter keiner Konformitätsbewertung nach EU-Maschinenverordnung unterliegt und somit Artikel 6 Absatz 1 Buchstabe b der EU-KI-Verordnung nicht erfüllt ist. Nach Artikel 25 Absatz 2 der EU-Maschinenverordnung unterliegen diejenigen Produkte einer Konformitätsbewertung, die in Anhang I Teil A aufgelistet sind. In diesem Anhang kommt besonders Ziffer 6 für den Roboter infrage. Ziffer 6 setzt jedoch voraus, dass der Roboter über ein «eingebettetes System» verfügt, das Sicherheitsfunktionen gewährleistet. Eine Sicherheitsfunktion ist nach Artikel 3 Ziffer 4 der EU-Maschinenverordnung eine Funktion, die als Schutzmassnahme zur Beseitigung oder Reduzierung eines Risikos dient und deren Ausfall zu einer Erhöhung des Risikos führt. Das im Roboter verbaute eingebettete System, der Bordcomputer, gewährleistet jedoch keine Sicherheitsfunktionen nach dieser Definition. Dies wird damit begründet, dass eine Überprüfung der Sicherheit einer Machine-Learning-Methode – wie sie etwa für das System zur Hindernisvermeidung (Obstacle Avoidance) eingesetzt wird – aus technischen Gründen derzeit nicht möglich ist. Wenn also nicht klar ist, wie sicher das System zur Hindernisvermeidung ist, gewährleistet dieses auch keine Sicherheitsfunktion. Dasselbe gilt für die Module Locomotion und die Inspection Intelligence. Da die Voraussetzungen aus den Buchstaben a und b kumulativ erfüllt sein müssen, führt die Antwort Nein an dieser Stelle zur Schlussfolgerung, dass kein HRKIS gemäss Artikel 6 Absatz 1 EU-KI-Verordnung vorliegt.

Es könnte jedoch auch ein HRKIS nach Artikel 6 Absatz 2 und Anhang III Ziffer 2 EU-KI-Verordnung vorliegen. Hierzu ist erforderlich, dass der Roboter ein Sicherheitsbauteil einer kritischen Infrastruktur ist. Das Sandbox-Team argumentiert, dass der Roboter mangels fester Verbindung zu einer kritischen Infrastruktur nicht als Bauteil gilt. Darüber hinaus übernimmt er – wie bereits ausgeführt – keine Sicherheitsfunktionen. Auf diese Weise entsteht das Ergebnis, dass der Roboter weder gemäss Artikel 6 Absatz 1 noch gemäss Artikel 6 Absatz 2 EU-KI-Verordnung als HRKIS einzustufen ist.

Option 2: Ausnahme gemäss Artikel 6 Absatz 3 EU-KI-Verordnung

Ein alternativer Entscheidungsweg ergibt sich über folgenden Pfad:

1. Ja | 2. Nein | 3. Ja | 4. Ja → D

Hier nimmt das Sandbox-Team mit derselben Argumentation wie bei Option 1 an, dass kein HRKIS nach Artikel 6 Absatz 1 EU-KI-Verordnung vorliegt. Hingegen geht es davon aus, dass der Roboter ein Sicherheitsbauteil einer kritischen Infrastruktur darstellt. Die Argumentation lautet, dass bei Ausfall des Roboters ein erhöhtes Risiko für die Sicherheit oder Gesundheit von Menschen entstehen kann und damit ein Sicherheitsbauteil im Sinne von Artikel 3 Ziffer 14 EU-KI-Verordnung vorliegt. Zusätzlich wird vertreten, dass der Begriff «Sicherheitsbauteil» nicht nur im wörtlichen Sinne auszulegen ist, sodass auch ein nicht fest verbautes System wie der Roboter als Bauteil gelten kann. Demnach liegt ein HRKIS nach Artikel 6 Absatz 2 EU-KI-Verordnung vor. Schliesslich sind die Ausnahmen nach Artikel 6 Absatz 3 EU-KI-Verordnung zu prüfen.

Trifft eine dieser Ausnahmen zu, dann liegt trotz der Erfüllung der Voraussetzungen von Artikel 6 Absatz 2 EU-KI-Verordnung kein HRKIS vor. Hier wird argumentiert, dass der Roboter keine eigenständigen Entscheidungen trifft, sondern lediglich vorbereitende Tätigkeiten für menschliche Entscheidungsträgerinnen und -träger übernimmt. Damit ist die Ausnahme gemäss Artikel 6 Absatz 3 Buchstabe d EU-KI-Verordnung einschlägig, und es liegt kein HRKIS vor. Insgesamt führt auch dieser Pfad zum Ergebnis, dass der Roboter weder nach Artikel 6 Absatz 1 noch nach Artikel 6 Absatz 2 EU-KI-Verordnung als HRKIS einzustufen ist.

Option 3: Nutzung von Übergangsvorschriften

Eine dritte Möglichkeit innerhalb des ersten Szenarios besteht darin, sich auf die Übergangsbestimmungen der EU-KI-Verordnung zu berufen. Nach Artikel 111 gilt die EU-KI-Verordnung für bereits auf dem Markt befindliche KI-Systeme nicht, sofern diese vor dem 2. August 2026 in Verkehr gebracht oder in Betrieb genommen wurden – es sei denn, es erfolgt eine wesentliche Veränderung der Konstruktion. Unklar bleibt jedoch, was unter einer wesentlichen Veränderung zu verstehen ist. Die EU-KI-Verordnung definiert eine «wesentliche Veränderung» als eine Änderung, die in der ursprünglichen, vom Anbieter durchgeführten Konformitätsbewertung nicht vorgesehen oder geplant war und entweder die Konformität des KI-Systems beeinträchtigt oder zu einer Änderung der Zweckbestimmung führt, für die das System bewertet wurde. Eine wesentliche Veränderung liegt somit nur dann vor, wenn infolge der Änderung die Einhaltung der EU-KI-Verordnung nicht mehr gewährleistet ist. In Anlehnung an die bisherige Praxis zur EU-Maschinenrichtlinie kann dabei darauf abgestellt werden, ob durch die Änderung eine neue Gefährdung entsteht oder ein bestehendes Risiko für die von der EU-KI-Verordnung geschützten Rechtsgüter erhöht wird.

«EU-Regulierungen wirken oft weniger drastisch auf Firmen als erwartet – wer Spielräume klug nutzt und Risiken pragmatisch analysiert, kann eine passende Strategie entwickeln.»

Sven Kohlmeier, Fachanwalt für IT-Recht (DE), Wicki Partners AG

Fazit zum ersten Szenario

Dieses Szenario bietet die Möglichkeit, die Einstufung des Roboters als HRKIS zu vermeiden. Ob die entsprechende Argumentation jedoch einer gerichtlichen Überprüfung standhalten würde, ist derzeit offen, da Rechtsprechung zu diesen Fragestellungen bislang fehlt. Vor dem Hintergrund des geopolitischen Wettbewerbs, etwa mit Blick auf die technologische Konkurrenz durch die USA, könnte eine weite Auslegung der EU-KI-Verordnung durch die EU gefördert werden. Wird der Roboter nicht als HRKIS eingestuft, unterliegt er keinen Konformitätsbewertungsverfahren nach EU-KI-Verordnung und muss lediglich die grundlegenden Anforderungen der Verordnung an KI-Systeme erfüllen. Allerdings könnte ein Konformitätsverfahren nach EU-Maschinenverordnung erforderlich bleiben. Ergänzend oder alternativ zur Argumentation gegen eine Qualifikation als HRKIS (Optionen 1 und 2) kann die Übergangsregelung (Option 3) genutzt werden, um die Anwendung der EU-KI-Verordnung vorläufig zu vermeiden.

II. Szenario 2: Qualifikation als HRKIS

n diesem Szenario wird angenommen, dass der Roboter künftig der neuen EU-Maschinenverordnung unterliegt und gemäss dieser durch eine notifizierte Stelle zertifiziert werden muss. Da damit die Voraussetzungen von Artikel 6 Absatz 1 Buchstabe a und b erfüllt sind, liegt ein HRKIS vor.

Zertifizierung nach EU-Maschinenverordnung

Wenn ein HRKIS vorliegt, empfiehlt das Sandbox-Team den Herstellern, zunächst das Konformitätsbewertungsverfahren nach EU-Maschinenverordnung durchzuführen. Dabei prüft die notifizierte Stelle gleichzeitig die Einhaltung der Anforderungen der EU-KI-Verordnung. Eine Zertifizierung nach EU-KI-Verordnung ist daher nicht erforderlich. Auf diese Weise müssen die Hersteller also ausschliesslich das bereits etablierte Verfahren durchlaufen. Das potenziell teurere, neue Verfahren nach EU-KI-Verordnung kann vermieden werden. Entscheidend ist, dass nach EU-Maschinenverordnung nicht der gesamte Roboter zertifiziert werden muss, sondern nur der sogenannte Bordcomputer – also die Steuerungseinheit, in der die KI-Funktionen verankert sind. Zertifizierungspflichtig sind «eingebettete Systeme mit selbstentwickelndem Verhalten», deren Ausfall das Risiko für Personen erhöht. Entsprechend könnten laut Diskussion mit dem Hersteller insbesondere folgende Module des Roboters zertifizierungspflichtig sein:

- Obstacle Avoidance:

Ein Ausfall könnte zu Unfällen führen. - Inspection Intelligence:

Ein Defekt könnte Risiken (z.B. unbeachtete Lecks) verursachen - Locomotion:

Ein Fehler könnte dazu führen, dass der Roboter stürzt und damit eine Gefährdung verursacht.

Für die Zertifizierung des Bordcomputers stehen drei Verfahren zur Auswahl (siehe dazu Kapitel 2.1):

- EU-Baumusterprüfung:

am besten geeignet; ein einzelnes Modell wird geprüft, keine laufenden Audits - Umfassende Qualitätssicherung:

ungeeignet wegen unangekündigter Audits - Einzelprüfung:

ungeeignet für Serienprodukte wegen hoher Kosten

Die übrigen Komponenten des Roboters, wie Beine oder Gehäuse, können weiterhin mit der internen Fertigungskontrolle geprüft werden.

Fazit zum zweiten Szenario

Die Argumentation im zweiten Szenario erfordert nur eine einzige Zertifizierung durch eine notifizierte Stelle – nämlich nach EU-Maschinenverordnung. Dabei wird gleichzeitig die Konformität mit der EU-KI-Verordnung geprüft. Nur der Bordcomputer muss extern zertifiziert werden, während der Rest des Roboters intern geprüft werden kann. Das geeignetste Konformitätsbewertungsverfahren für ANYbotics ist die EU-Baumusterprüfung. Weiter müssen die Pflichten für HRKIS-Anbieter gemäss EU-KI-Verordnung beachtet werden. Die Vorteile des zweiten Szenarios liegen in einem geringeren rechtlichen Risiko und in etablierten Verfahren. Nachteilig ist, dass höhere Anforderungen zu erfüllen sind als beim ersten Szenario.

Handlungsempfehlungen

Die Entscheidung zwischen den unterschiedlichen Argumentationsszenarien ist nicht allein juristisch zu treffen, sondern setzt auch eine unternehmerische Abwägung voraus. Sollte der Roboter ohnehin unter die EU-Maschinenverordnung fallen, empfiehlt das Sandbox-Team, die Umsetzungsstrategie aus Szenario 2 zu wählen, das Zertifizierungsverfahren nach EU-Maschinenverordnung zu durchlaufen – idealerweise in Form der EU-Baumusterprüfung – und damit gleichzeitig die Anforderungen der EU-KI-Verordnung abzudecken.

Checkliste für Hochrisikosysteme

Für die Anbieter von HRKIS stellt die EU-KI-Verordnung einige Pflichten auf. Die EU-Maschinenverordnung enthält Pflichten für Hersteller von Maschinen, die deckungsgleich oder ähnlich sind (siehe vierte Spalte). Daher sind mit dem Durchlaufen des Konformitätsbewertungsverfahrens nach der EU-Maschinenverordnung schon einige Pflichten nach der EU-KI-Verordnung zumindest teilweise erfüllt. Hier sind alle Pflichten als Checkliste aufgelistet, die die EU-KI-Verordnung Anbietern von HRKIS auferlegt:

|

Erledigt

|

Pflicht

|

Artikel in der EU-KI-Verordnung

|

Ähnliche Pflicht nach EU-Maschinenverordnung

|

|---|---|---|---|

| x | Anbringen von Name, Marke und Kontaktanschrift | 16 b) | 10 VI |

| x | Einrichten eines Qualitätsmanagementsystems | 16 c), 17 | Bei umfassender Qualitätssicherung: Anhang IX Ziffer 3; bei Einzelprüfung: Anhang X Ziffer 2 Unterabsatz 3 ii) |

| x | Erstellen und Aufbewahren von Dokumentationen | 16 d), 11, 17, 47, 18 | 10 II, Anhang IV Teil A |

| x | Aufbewahren von automatisch erstellten Protokollen (Logs) für 6 Monate | 16 e), 12, 19 | Anhang III Teil B Ziffer 1.2.1. Unterabsatz 3 b): Aufbewahrung für 1 Jahr |

| x | Durchführen eines Konformitätsbewertungsverfahrens (im Fall ANYbotics nach EU-Maschinenverordnung) | 16 f), 43 III, Verordnung (EU) 2023/1230 | 10 II, 25 |

| x | Ausstellen einer EU-Konformitätserklärung | 16 g), 47 | 10 II |

| x | Anbringen einer CE-Kennzeichnung | 16 h), 48 | 10 II |

| x | Ergreifen von Korrekturmassnahmen, falls HRKIS nach Inverkehrbringen nicht (mehr) mit der EU-KI-Verordnung konform | 16 j) | 10 IX |

| x | Bei Nachfrage durch Behörde: Nachweis der Erfüllung der Anforderungen an HRKIS | 16 k), 8–15 | 10 X |

| x | Einrichten eines Risikomanagementsystems | 9 | Anhang IV Teil A b): Risikobeurteilung |

| x | Erstellen einer technischen Dokumentation, die Angaben nach EU-KI- und EU-Maschinenverordnung enthält | 11, Anhang IV, Verordnung (EU) 2023/1230 | Anhang IV Teil A |

| x | Erstellen einer Betriebsanleitung, die transparente Bedienung ermöglicht | 13 | 10 VII |

| x | Beaufsichtigung durch Menschen | 14 | Anhang III Teil B Ziffer 3.2.4 |

| x | Gewährleisten von genügender Genauigkeit, Robustheit und Cybersicherheit | 15 | Anhang III Teil B Ziffer 1.1.9: Schutz vor Korrumpierung |

| x | Barrierefreier Zugang zu Websites und Produkten | 16 l), Richtlinie (EU) 2016/2102, Richtlinie (EU) 2019/882 | |

| x | Einrichten eines Data-Governance-Verfahrens, damit die Trainingsdaten möglichst fehler- und biasfrei sind | 10 | |

| x | Einrichten eines Systems zur Beobachtung des HRKIS nach Inverkehrbringen (Kunden von ANYbotics müssen hierzu Daten weiterleiten) | 72 | |

| x | Melden schwerwiegender Vorfälle an Marktüberwachungsbehörde | 73 | |

| x | Wenn Behörde dies vorsieht: Prüfung der Konformität mit EU-KI-Verordnung durch Marktüberwachungsbehörde | 79, Verordnung (EU) 2019/1020 | |

| Entfällt | Registrierung in der EU-Datenbank für HRKIS nach Anhang III (ANYbotics fällt nicht unter Anhang III) | 16 i), 49, 71, Anhang III |

3.3. KI-Governance und ISO/IEC 42001

Unabhängig davon, ob ein autonomer Inspektionsroboter regulatorisch als HRKIS qualifiziert wird oder nicht, gewinnt eine systematische KI-Governance zunehmend an Bedeutung. Denn die regulatorischen Anforderungen in den Bereichen KI, Cybersicherheit, Produktsicherheit und Datenzugang werden in den kommenden Jahren weiter zunehmen – sowohl in der EU als auch weltweit.

Eine strukturierte Governance ermöglicht es, bestehende und künftige Anforderungen gezielt zu berücksichtigen, ohne für jedes neue Regulierungsinstrument ein separates Konzept entwickeln zu müssen. Denn in einem zentral verankerten KI-Management-System lassen sich verschiedene regulatorische Vorgaben abbilden – etwa solche aus der EU-KI-Verordnung, aber auch KI-bezogene Vorgaben aus der EU-Maschinenverordnung oder KI-Regulierungen in anderen Regionen, die als Markt interessant sind.

Im folgenden Abschnitt wird anhand von ISO/IEC 42001 3 ein möglicher Umsetzungsansatz für eine solche KI-Governance vorgestellt. Die internationale Norm definiert erstmals ein strukturiertes Managementsystem speziell für den verantwortungsvollen Einsatz von KI. Sie baut auf etablierten Prinzipien des Informationssicherheits- und Qualitätsmanagements auf und überträgt diese auf KI-spezifische Risiken und Steuerungsprozesse. Das Konzept eines KI-Management-Systems wurde im Rahmen des Sandbox-Projekts mit ANYbotics in Zusammenarbeit mit dem Zürcher Unternehmen Modulos AG praktisch getestet. Ziel war es, ein schlankes, System vorzubereiten, das regulatorische Anforderungen strukturiert adressiert und gleichzeitig als modulare Grundlage dient, um bei Bedarf gezielt regulatorische Lücken (z.B. aus der EU-KI-Verordnung oder der EU- Maschinenverordnung) zu füllen. Dabei sind die Erfahrungen aus dem Anwendungsfall eingeflossen – insbesondere bei der Systemabgrenzung, bei der organisatorischen Verankerung sowie bei ausgewählten Dokumentations- und Steuerungsinstrumenten.

«Wer KI-Governance systematisch verankert, schafft Sicherheit, reduziert Risiken und gewinnt langfristig Marktzugang.»

Elena Maran, Global Head of Responsible AI, Modulos AG

Motivation und Zielsetzung

Das Ziel war, die Einführung eines KI-Management-Systems gemäss den Anforderungen der ISO/IEC 42001 vorzubereiten – als ersten konkreten Schritt zur Verankerung einer KI-Governance im Unternehmen. Dies erfolgte vor dem Hintergrund, dass zum Zusammenspiel zwischen der EU-KI-Verordnung und der EU-Maschinenverordnung noch keine abschliessende Rechtsklarheit besteht. Die Entscheidung, ein KI-Management-System einzuführen, wurde durch mehrere zusammenwirkende Faktoren motiviert. Zum einen ist ANYbotics in stark regulierten Branchen tätig – darunter Öl und Gas, Bergbau, chemische Industrie und Energieerzeugung – und agiert in über 20 Ländern. Zum anderen bilden KI-Technologien einen wesentlichen Bestandteil des Produkts des Unternehmens, und die Einhaltung regulatorischer Anforderungen gewinnt zunehmend an Bedeutung – insbesondere im Hinblick auf die potenzielle Einstufung autonomer Robotersysteme als Hochrisikoanwendungen gemäss EU-KI-Verordnung. Zusätzlich haben Kundenanforderungen an die KI-Governance und der Wunsch nach wettbewerblicher sowie verantwortungsvoller KI-Entwicklung das Vorhaben, ein umfangreiches KI-Governance-Framework anzustreben, begünstigt. Zudem erhöht ein implementiertes KI-Management-System das Vertrauen der Kunden.

Technische Herausforderungen und regulatorische Komplexität

Rahmen der Vorbereitung des KI-Management-Systems bei ANYbotics traten typische Herausforderungen auf, wie sie bei KI-gestützten Robotiksystemen im industriellen Umfeld regelmässig zu beobachten sind. Besonders relevant sind die folgenden Punkte:

Verwenden Sie die Akkordeon-Bedienelemente, um die Sichtbarkeit der jeweiligen Panels (unterhalb der Bedienelemente) umzuschalten.

Der Einsatz von ANYmal in Anlagen wie Raffinerien, Chemieanlagen oder Kraftwerken bringt erhebliche Sicherheitsanforderungen mit sich. Eine fehlerhafte Navigation oder Fehlentscheidungen der KI können in solchen Kontexten schwerwiegende Folgen haben.

Für zentrale Funktionen wie die Bildverarbeitung werden teilweise externe KI-Module eingesetzt. Die Validierung, die Nachvollziehbarkeit und die langfristige Wartung solcher Komponenten sind besonders anspruchsvoll – insbesondere im Hinblick auf regulatorische Anforderungen.

Unterschiedliche Lichtverhältnisse, strukturelle Veränderungen in Anlagen, Witterungseinflüsse oder Verschmutzungen können die Leistung von KI-Modellen im Feld verändern. Die Stabilität und die Robustheit der Modelle müssen daher laufend überwacht und getestet werden.

ANYbotics ist international tätig und muss regulatorische Vorgaben aus verschiedenen Jurisdiktionen erfüllen. Die Abstimmung zwischen der EU-KI-Verordnung, der EU-Maschinenverordnung und weiteren nationalen Regelwerken stellt eine erhebliche Herausforderung dar

Das System wird in vierteljährlichen Zyklen weiterentwickelt. Dies erfordert stringente Prozesse zur Versionierung, Testdokumentation, Freigabe und Rückverfolgbarkeit – insbesondere bei sicherheitskritischen Komponenten.

Das Robotersystem ANYmal kombiniert fortschrittliche KI wie Deep Learning oder Reinforcement Learning und generative KI für Computer Vision, Navigation und Inspektion. Gerade diese technische Komplexität unterstreicht die Notwendigkeit eines strukturierten, risikobasierten KI-Governance-Ansatzes – sowohl um regulatorische Anforderungen zu erfüllen als auch um Sicherheit, Qualität und Skalierbarkeit im Betrieb sicherzustellen. Die bestehenden Information-Security-Management- und Safety-Strukturen waren eine wichtige Grundlage, um KI-spezifische Risiken mit eigenständigen, spezialisierten Governance-Strukturen zu adressieren.

Risikobewertung

Die Risikoanalyse ergab für ANYbotics ein mittleres Risiko, das durch das komplexe regulatorische Umfeld, den autonomen Einsatz der Systeme sowie die technologische Komplexität der KI-Komponenten geprägt ist. Zwar reduzieren das bestehende Information-Security-Management-System und etablierte Risikomanagementprozesse die Verwundbarkeit, jedoch besteht insbesondere beim Aufbau dedizierter Ressourcen für KI-Governance noch Entwicklungspotenzial.

|

|

Bewertung Gesamtrisiko Mittel

|

|

|---|---|---|

| Extern | Operativ | Technisch |

Regulatorischen Kontext bewerten:

|

Betrieblichen Einsatz beurteilen:

|

Systemautonomie einschätzen:

|

Zentrale KI-Risiken

Die umfassende Risikoanalyse hat zehn kritische Risiken identifiziert, die sich auf drei miteinander verbundene Kategorien verteilen.

Verwenden Sie die Akkordeon-Bedienelemente, um die Sichtbarkeit der jeweiligen Panels (unterhalb der Bedienelemente) umzuschalten.

Sie konzentrieren sich auf das komplexe regulatorische Umfeld sowie auf Herausforderungen im Stakeholder-Management. Schwierigkeiten bei der regulatorischen Konformität resultieren aus sich ständig weiterentwickelnden KI-Vorgaben in unterschiedlichen Rechtsräumen. Gleichzeitig zeigen sich Risiken gegenüber Stakeholdern, insbesondere bei der klaren Vermittlung der Fähigkeiten und Grenzen der KI-Systeme gegenüber Industriepartnern, die oft in risikoaversen Umfeldern operieren.

Sie entstehen durch die besonderen Anforderungen beim Einsatz autonomer Systeme mit Echtzeitentscheidungsfindung in sicherheitskritischen Kontexten. Um potenzielle Sicherheitsrisiken zu vermeiden, ist es essenziell, dass die Systeme von Menschen überwacht werden können. Lücken in der übergeordneten KI-Governance machen zudem deutlich, dass strukturierte Verantwortlichkeitsmechanismen erforderlich sind. Herausforderungen im Updatemanagement ergeben sich aus dem vierteljährlichen Roll-out-Zyklus, während Risiken der Laufzeitkompromittierung die Anfälligkeit autonomer Systeme für gezielte Angriffe unterstreichen – mit potenziellen Auswirkungen auf Betriebssicherheit und Funktionsfähigkeit.

Sie dominieren die Bewertung. Sie umfassen grundlegende Herausforderungen in Bezug auf die Zuverlässigkeit und die Robustheit von KI-Systemen in unvorhersehbaren industriellen Umgebungen sowie die inhärente Intransparenz von Entscheidungsprozessen in komplexen Reinforcement-Learning-Systemen. Besonders hervorzuheben ist das Risiko des Modell-Drift, das auf die dynamischen Bedingungen in Inspektionsumgebungen zurückzuführen ist. Hinzu kommen Herausforderungen bei der Datenqualität sowie KI-spezifische Sicherheitslücken, die fortlaufende operationelle Hürden darstellen und gezielte Gegenmassnahmen erfordern.

|

Category

|

Risk

|

Impact

|

Controls

|

|---|---|---|---|

| Technical | Al System Reliability and Robustness | Critical | A. 6.2.4, A.6.2.6 |

| Technical | Opacity of Decision-Making | High | A. 6.2.3, A.6.2.7 |

| Technical | Al Model Drift | Medium | A. 6.2.6, A. 6.2.8 |

| Technical | Data Quality Issues | High | A.7.4, A.7.6 |

| Technical | Al-Specific Security Vulnerabilities | High | A. 6.2.3, A.6.2.7 |

| Technical | Al Update Management | Medium | A. 6.2.5, A.6.2.6 |

| Technical | Al Governance Gaps | Critical | A. 2.2, A.3.2 |

| Technical | Runtime Al System Compromise | High | A. 6.2.5, A. 6.2.6, A.9.4 |

| Technical | Regulatory Compliance | High | A.2.3, A.8.5 |

| Technical | Stakeholder Communication | Medium | A.8.2, A.8.4 |

Erklärung zur Anwendbarkeit

Die zehn identifizierten Risiken bildeten die Grundlage für die Auswahl und die Priorisierung der im KI-Management-System umgesetzten Kontrollmassnahmen. Dabei zeigte sich, dass viele der Herausforderungen im technischen und im operationellen Bereich spezifische Governance-Instrumente erfordern. Basierend auf der Doppelrolle von ANYbotics als KI-Anbieter und -Hersteller mit einem mittleren Risiko umfasst das Statement of Applicability alle wesentlichen Kontrollen aus Anhang A der ISO/IEC 42001, mit Ausnahme der Bewertung gesellschaftlicher Auswirkungen (A.5.5). Diese wurde aufgrund des begrenzten Anwendungskontexts im Bereich industrieller Inspektionen ausgeschlossen. Im Fokus der relevanten Kontrollen stehen insbesondere:

- KI-Richtlinien (A.2)

- Governance-Rollen (A.3)

- Lebenszyklusmanagement (A.6)

- Daten-Governance (A.7)

- Verantwortungsvoller Einsatz (A.9)

Risikobasierte Priorisierung der Implementierungskontrollen

Die Priorisierung der Kontrollen basierte auf einem mittleren Risiko, der Doppelrolle als KI-Anbieter und -Hersteller, der vorhandenen Information-Security-Management-Struktur sowie auf dem Umstand, dass keine sensitiven Personendaten verarbeitet werden. Dadurch konnte gezielt auf jene Anforderungen fokussiert werden, die für die industrielle Robotik besonders relevant sind – etwa Systemzuverlässigkeit, strukturelle Governance und KI-spezifische Sicherheitsaspekte. Die Umsetzungs-Roadmap priorisierte drei kritische Risiken:

- Zuverlässigkeit und Robustheit der KI-Systeme:

Aufbau von Verifizierungs- und Validierungsprozessen sowie von umfassenden Monitoring-Frameworks (bspw. durch Machine Learning Operations) - Lücken in der KI-Governance:

Etablierung formeller Governance-Strukturen und Definition von Rollen und Zuständigkeiten - KI-spezifische Sicherheitslücken:

Dokumentation von Sicherheitskontrollen und Umsetzung gezielter Strategien zur Schwachstellenminimierung

Dieser strukturierte und risikoorientierte Ansatz ermöglichte eine zielgerichtete Einführung des KI-Management-Systems bei gleichzeitig effizientem Ressourceneinsatz – ohne flächendeckende Überforderung der Organisation.

|

Priority

|

Risk

|

Controls

|

Control Descriptions

|

|---|---|---|---|

| x | Al System Reliability and Robustness | A.6.2.4, A.6.2.6 | Verification and validation processes, monitoring framework |

| x | Al Governance Gaps | A.2.2, A.3.2 | Establish governance structure, define roles and responsibilities |

| x | Al-Specific Security Vulnerabilities | A.6.2.3, A.6.2.7 | Document security controls, vulnerability mitigation |

Empfehlungen für ähnliche Organisationen

Die Erfahrung von ANYbotics zeigt mehrere kritische Erfolgsfaktoren für die Implementierung der ISO/IEC 42001:

- Managementsupport ist entscheidend. Die Unterstützung durch das Management ist essenziell für die Ressourcenbereitstellung und das Überwinden interner Hürden während der Governance-Transformation.

- Auf bestehenden Strukturen aufbauen statt bei null anfangen. Die etablierten Information-Security-Management- und Safety-Prozesse bilden ein solides Fundament. Das zeigt, wie bestehende Governance-Strukturen genutzt und erweitert werden können – mit Zeitgewinn und minimaler Störung operativer Abläufe.

- Externe Expertise ist ein zentraler Erfolgsfaktor. Die Unterstützung durch spezialisierte Beratende bei der Gap-Analyse ermöglicht es, typische Fallstricke zu vermeiden und das organisationsinterne Lernen zu beschleunigen – besonders in Bereichen mit geringer interner Governance-Erfahrung.

- Eine umfassende Risikoanalyse ist die Grundlage für alle weiteren Schritte. Nur so lassen sich Ressourcen auf die wirkungsvollsten Massnahmen fokussieren.

- Eine lückenlose Dokumentation aller Prozesse und Entscheidungen schafft die für eine Zertifizierung notwendige Nachvollziehbarkeit.

- Quick Wins im Projektverlauf helfen zudem, die Motivation über den langen Implementierungszeitraum hinweg aufrechtzuerhalten.

Herausforderungen für die Umsetzung

Organisationen sollten auch typische Fehler vermeiden:

- Eine gleichzeitige Umsetzung in allen Bereichen überfordert die Teams und lenkt von prioritären Risiken ab.

- Das Auslassen von Impact-Assessments führt zu blinden Flecken, die spätestens bei der Auditierung aufgedeckt werden.

- Die Isolation von bestehenden Governance-Strukturen verursacht unnötige Zielkonflikte und Doppelspurigkeit.

- Häufig wird der kulturelle Wandel unterschätzt – fehlendes Change-Management verlangsamt die Akzeptanz.

- Ein verspäteter Aufbau von Monitoring-Systemen verhindert die frühzeitige Erkennung von Umsetzungslücken, was später zu deutlich höheren Kosten führen kann.

Bitte geben Sie uns Feedback

Ist diese Seite verständlich?

Vielen Dank für Ihr Feedback!

Kontakt

Amt für Wirtschaft – Standortförderung

Montag bis Freitag

8.00 bis 12.00 Uhr und

13.30 bis 17.00 Uhr